近期业务需要通过tc将某些网卡流量通过隧道镜像到其他IP进行分析。实现思路参考这篇文章:

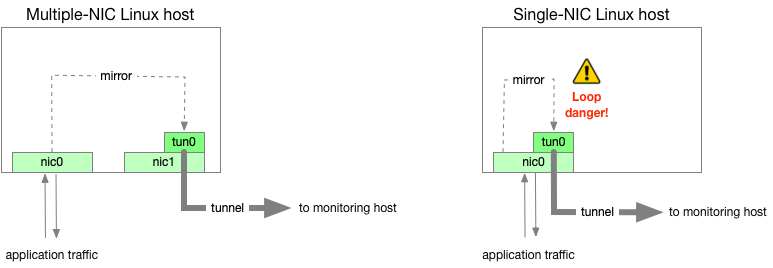

理想情况上,采集网卡和隧道承载网卡应该是不同网卡。然而,一些服务器不具备多块网卡。当它们使用同一网卡时很容易形成环路,如下图(来自上述文章):

上述文章也提到Linux内核存在BUG,当直接从egress队列镜像到隧道接口时,可能会导致死锁。比如RedHat这个kb链接:

解决方案是可以先将流量镜像到loopback接口, 再从loopback接口镜像到隧道接口。这种方式下,我们可以在lo接口上添加bpf规则避免形成环路,也可以按需求添加bpf规则过滤不需要的流量。

但实际上这样依然存在风险。根据tc官方说明,这么做还是不推荐的:

1 | What NOT to do if you don't want your machine to crash: |

我们场景的转发路径就是:eth0->lo->vxlan->eth0。根据我们较长时间的实践,确认这样的确会触发BUG。经过研究,我们可以实现额外的loopback接口设备来规避BUG。后续其他文章再来说明该BUG及解决方案,本文来分析镜像流量是否会影响netfilter。

因为我们的服务器上还运行着自开发的netfilter内核模块,那么流量镜像到lo接口后,流量会经过NF_HOOK吗?

为了确定这个问题,开始进行实验调研。

实验机器网卡eth1的IP为:192.168.33.12,在eth1上配置镜像egress方向的TCP端口为9091的流量到lo网卡:

1 | tc qdisc add dev eth1 root handle 1: htb |

命令中的bpf字节码可以通过iptables的工具nfbpf_compile来生成:

1 | [root@default bin]# ./nfbpf_compile EN10MB 'tcp port 9091' |

然后编写实验用的netfilter模块, 它在收到9091端口的数据包时打印设备名称:

1 |

|

Makefile内容为:

1 | .PHONY: all |

编译并加载:

1 | make |

接着,使用tcpdump在lo接口上抓包,并从该机器上向外访问9091端口来发送TCP syn包:

1 | [root@default ~]# curl http://192.168.33.1:9091 -v |

这时lo接口上tcpdump的输出:

1 | [root@default nfqlo]# tcpdump -ilo -nn tcp port 9091 |

运行dmesg查看内核模块的输出:

1 | [ 273.621144] [nfqlo]: DEV: (no dev) |

可以看到,tcpdump在lo上抓到了数据包,而从dmesg输出看到,数据包并未进入netfilter处理。

那么数据包在哪里被丢弃的呢?我们继续分析。

IP协议栈入口函数为ip_rcv, 在执行完NF_HOOK之后会调用ip_rcv_finish,ip_rcv源码(CentOS的linux-3.10.0-1127.el7.x86_64)如下:

1 | /* |

我们使用systemtap工具来查看两个函数的执行情况。编写systemtap脚本hook两个函数:

1 | probe kernel.function("ip_rcv") { |

运行systemtap并再次发送请求后输出如下:

1 | [root@default systemtap]# stap -g -v 1.stap |

可以看到ip_rcv被调用了,而ip_rcv_finish没有被调用,可以确认数据包是在ip_rcv函数中被丢弃了。

从源码分析,ip_rcv函数开头部分的pkt_type检查逻辑是最可疑的地方:

1 | /* When the interface is in promisc. mode, drop all the crap |

修改systemtap脚本,添加pkt_type输出:

1 | printf("ip_rcv_finish: skb: %p, %s:%d->%s:%d, dev: %s, pkt_type: %d\n", $skb, saddr, sport, daddr, dport, kernel_string($skb->dev->name), $skb->pkt_type) |

再次运行并发送请求后,确认skb->pkt_type的确为PACKET_OTHERHOST, 数据包被丢弃:

1 | ip_rcv: skb: 0xffff8d6410ced200, 192.168.33.12:52986->192.168.33.1:9091, dev: lo, pkt_type: 3 |

1 |

那么skb->pkt_type是哪里赋值为PACKET_OTHERHOST的呢?

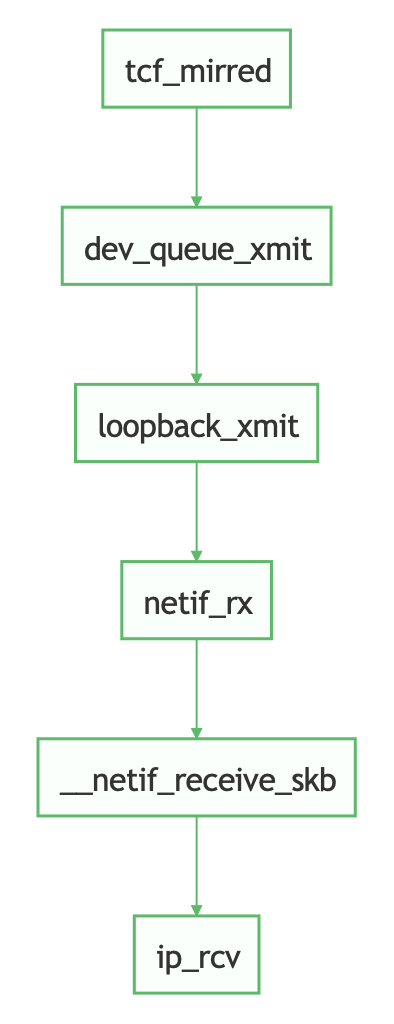

梳理tc镜像流量的网络路径,有如下这些观察点:

tc镜像流量时会调用tcf_mirred函数- 流量为

egress方向,tcf_mirred会调用dev_queue_xmit dev_queue_xmit最终会调用网卡驱动的.ndo_start_xmit函数,lo网卡的ndo_start_xmit为loopback_xmitloopback_xmit会调用netif_rx函数,最终会调用__netif_receive_skb函数__netif_receive_skb会调用ip_rcv函数

如图所示:

再次修改systemtap脚本:

1 | %{ |

运行脚本并再次请求后输出:

1 | dev_queue_xmit: skb: 0xffff8d643ce40af8, 192.168.33.12:52996->192.168.33.1:9091, dev: eth1, pkt_type: 0 |

可以看到skb_clone后的sk_buff地址为0xffff8d6423433800, 它在进入loopback_xmit时,pkt_type为0,在进入netif_rx时,pkt_type变为了3。

再来看loopback_xmit的源码:

1 | /* |

可以看到,loopback_xmit在调用netif_rx前调用了eth_type_trans函数。eth_type_trans函数源码如下:

1 | /** |

可以看到,eth_type_trans函数会比较数据包的目的地址和设备的物理地址,当二者不一致时就会将skb->pkt_type设置为PACKET_OTHERHOST。

1 | if (unlikely(!ether_addr_equal_64bits(eth->h_dest, |

至此,我们可以确定整个过程: 当流量被tc镜像到lo接口后,继续走lo设备的发送流程,过程中由于镜像过来的数据包的目的MAC地址和lo接口的MAC地址不一致,从而将skb->pkt_type设置为PACKET_OTHERHOST, 表示数据包不是发送给该接口的。loopback_xmit继续调用netif_rx函数接收数据包,执行到ip_rcv时,由于pkt_type为PACKET_OTHERHOST而被丢弃。

参考: