RDO是在RHEL,Fedora, CentOS等系统上部署OpenStack的方案。简单的试用或研究OpenStack可以选择all-in-one模式安装。这种模式将所有的OpenStack组件都部署在同一台机器上。本文来分析这种模式下虚拟网络的架构。

all-in-one模式安装完成时,RDO自动完成了以下工作:

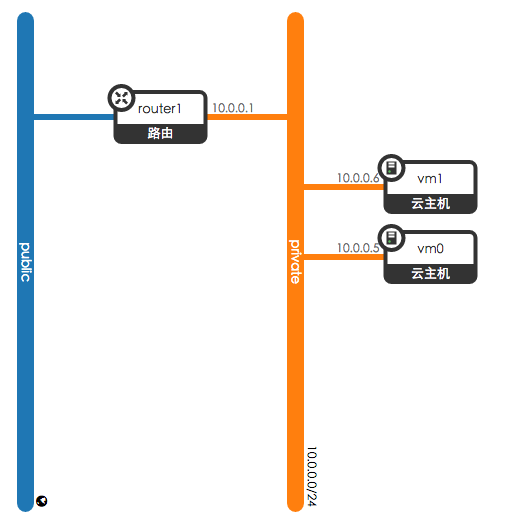

- 创建了外部网络public:

172.24.4.224/28 - 创建了租户demo

- 为租户demo创建了私有网络private:

10.0.0.0/24 - 为租户demo创建路由器router1, 将private和public连接在一起

我们登录demo租户,创建两个虚拟机,网络拓朴图如下:

本文基于该拓朴分析虚拟网络架构。